DeepSeek总是提示“服务器繁忙,请稍后再试。”的问题的解决办法(替代网站推荐)

文章目录

- 问题现象

- 原因分析

- 替代网站的可行性分析

- 替代网站

- 腾讯元宝

- 百度AI搜索

- 秘塔搜索

- Kimi

- C知道

- 超算互联网

- 360 纳米AI助手

- 百度云千帆

- 字节跳动火山引擎

- 阿里云PAI

- 硅基流动

- 其他

- 文思助手

- Fireworks

- 英伟达

- POE

问题现象

- 频繁遇到错误提示: 在使用DeepSeek时(开启“深度思考(R1)”、“联网搜索”)频繁遇到“服务器繁忙,请稍后再试”的提示信息。这一情况不仅出现在初次请求时,在多次尝试后依旧无法得到改善。

- 重新生成无效: 尝试通过点击“重新生成”来获取新的结果时,并没有起到任何效果,系统依然返回同样的“服务器繁忙,请稍后再试”的结果。

- 开启新会话无果: 即使选择通过点击“开启新会话”以期解决问题,仍然收到相同的“服务器繁忙,请稍后再试”错误提示。

- 首次使用正常之后失效: 首次使用DeepSeek时,通常能够正常生成答案。然而,一旦开始后续的交互,系统就会持续显示“服务器繁忙,请稍后再试”。一般需要等待大约15到30分钟左右(因流量高峰而波动),才能再次获得一次正常的回答机会。

原因分析

DeepSeek 频繁出现 “服务器繁忙,请稍后再试” 提示的本质问题在于算力不足。当前,由于短时间内难以采集到足够数量的 GPU,同时 AI 服务的 GPU 集群扩展也并非易事,无法简单快速地完成。因此,在现有条件下,DeepSeek 服务器繁忙的问题短期内难以得到有效解决。

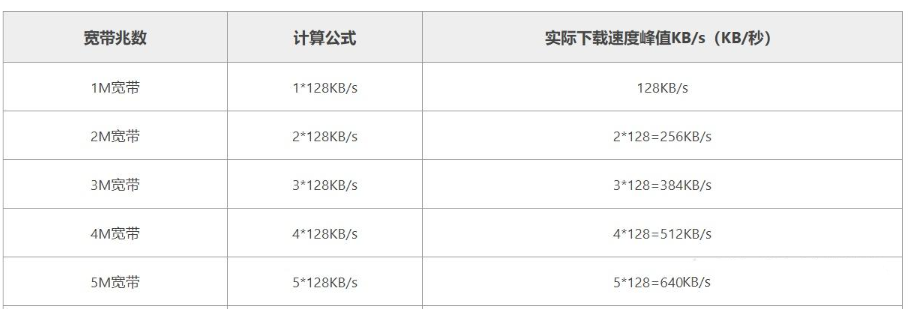

- 用户规模爆发式增长:DeepSeek成为现象级热点后,用户规模呈现爆发式增长态势。从节前百万级DAU(日活跃用户)急剧攀升至数千万量级,峰值时段并发请求量更是突破亿级。如此迅猛的用户增长速度,使得对算力的需求呈几何倍数增长 ,已无法满足目前承载能力。

- 算力资源有限:算力(GPU)是制约DeepSeek服务质量的关键因素。尽管DeepSeek在降低训练成本上取得一定成果,但提供AI推理问答服务仍需消耗大量算力。DeepSeek背后的幻方量化拥有大约1万枚英伟达A100显卡。此外,DeepSeek自身拥有约50,000个基于Hopper架构的GPU,这其中包括了10,000个H800和10,000个H100型号,以及其他为中国市场设计的H20型号GPU等。然而,在这些显卡的算力分配中,用于自身业务、研发以及备用的部分占据了相当比例,真正用于C端服务的算力十分有限。面对激增的用户请求,现有用于C端服务的算力难以满足需求。

- 算力不足导致服务调整:因算力不足,DeepSeek已经暂停了API服务的充值,这一举措从侧面反映出其算力资源的紧张状态。

替代网站的可行性分析

替代网站可以实现接近 DeepSeek-R1 的效果,并实现完整的AI推理(思维链)功能。但是,不可能完美复制 DeepSeek 并达到完全一致的效果。

-

DeepSeek 开源模型:

- DeepSeek 发布的论文为其技术原理与架构提供了理论基础,官方开源的模型权重和部署代码,为开发者深入研究其代码逻辑提供了便利。

- 训练代码和完整数据集未完全公开,所以,并不能通过开源模型来完美复制 DeepSeek。

- Open-R1社区已经发布了如 Bespoke-Stratos-17k、OpenR1-Math-220k 等数据集来复现训练流程,能够达到接近 DeepSeek-R1 的性能。

-

AI 推理:

- 依据 DeepSeek 开源模型,在替代网站上是可以实现同样推理能力的,所以替代网站是能够展示出思维链的结果。但同样因为数据集的影响不可能完美复制。

- DeepSeek 在对话时内置的 “隐藏提示词” 或 “预设引导机制” 是黑盒,替代网站无法保持一致并会对效果产生影响。

-

不同版本:

- DeepSeek R1多参数级别:DeepSeek R1拥有多个不同参数规模的模型版本,从较小参数规模到超大规模,以适配不同硬件资源和应用场景需求。选择替代网站时需要注意其选用的参数级别。

- 满血版DeepSeek R1(671B):是DeepSeek R1系列中参数达6710亿的完整版本,性能最强、功能最全,能处理复杂自然语言任务,生成高质量文本,但对硬件计算资源和内存要求极高,训练和推理成本高昂。

- 其他版本概述:包括1.5B、8B、7B、14B、32B、70B等,是在满血版基础上优化调整得到的不同参数版本,性能虽不及满血版,但在各自参数级别能处理常见自然语言任务,硬件要求和训练推理成本低,适合资源有限、任务简单的场景。

替代网站

腾讯元宝

官网链接:https://yuanbao.tencent.com/

腾讯元宝是腾讯旗下首款深度集成DeepSeek-R1满血版的AI助手,依托腾讯混元大模型与微信生态,提供实时联网搜索、多模态交互及跨场景智能服务。

- DeepSeek-R1满血版深度推理:用户可手动切换至DeepSeek-R1模型,调用其完整版深度思考能力,是几大家主流AI对话产品中目前唯一一家引入第三方模型(即Deepseek)的,不仅如此,现在还在各个平台大力打广告,将DeepSeek-R1满血版作为自己的标签。

- 微信生态实时联网搜索:独家整合微信公众号、视频号等内容源,答案精准度与时效性超越通用搜索引擎。

- 自家模型的长思考支持::腾讯自家的混元大模型也支持了“深度思考(T1)”功能。

- 全平台全功能:支持网页端、iOS/Android客户端及微信小程序三端互通,作为主流AI对话产品之一其功能全面,包括支持多模态AI等。

百度AI搜索

官网链接:https://chat.baidu.com/search

百度AI搜索是百度推出的智能搜索引擎,现已支持DeepSeek-R1满血版,为用户提供高效、精准的搜索体验。

- DeepSeek-R1满血版:百度AI搜索现已支持DeepSeek-R1满血版。

- 功能有待完善:虽然也支持多模态和联网搜索等,但可能由于是搜索的附属产品,实际产品功能的体验还有待打磨,有不少问题:比如输入比较长时可能会DeepSeek-R1推理不生效,还有复制答案格式都是错乱等问题。

秘塔搜索

官网链接:https://metaso.cn/

秘塔AI搜索是目前最主流的DeepSeek R1满血版替代方案,直接集成671B全尺寸模型,提供与官方一致的推理性能。用户无需订阅付费,注册即可通过网页端使用,每日免费额度高达100次。

- 长思考-R1模式:开启后可调用DeepSeek R1的深度推理能力,生成包含完整思维链的答案,适合复杂问题解决。

- 联网搜索整合:结合全网实时数据与学术文献库,增强答案的准确性和信息覆盖范围。

- 稳定性优势:与官方服务器频繁繁忙不同,秘塔提供稳定服务,且操作界面与DeepSeek高度相似,用户无需适应成本。

Kimi

官网链接:https://kimi.com/

Kimi 智能助手是由 Moonshot AI 开发的先进人工智能助手,目前也已提供长思考功能,能够处理复杂的对话和任务,提供深入和全面的回答。

- 长思考支持:Kimi 最新上线了“k1.5 长思考”功能,能够进行长篇幅的思考和回答,适合处理复杂问题和任务。

- 长思考目前仍为预览版:官方提示为:由于测试时算力限制,当前预览版本在基准测试中的表现可能略逊于 k1.5 正式版。完整的 k1.5 模型将很快进行效率优化并上线。

- 多轮对话:支持多轮对话,理解上下文,提供连贯和相关的回答。

- 文件处理:可以处理多种文件格式,包括文本、PDF、Word 文档等,帮助用户快速获取所需信息。

- 搜索能力:结合全网实时数据和学术文献库,提供准确和全面的信息。

C知道

官网链接:https://so.csdn.net/chat

C知道是CSDN推出的智能对话工具,专注技术领域问答,集成多模态大模型能力,支持代码生成、问题调试及技术方案查询,面向开发者提供每日免费试用权限。

- 免费策略:未登录用户每日限10次提问,注册后提升至50次,会员享无限次使用+优先响应权益。

- DeepSeek R1满血版目前限免:访问“C知道”首页后,点击“对话”,选择“DeepSeek R1满血版”,目前限时免费。

- 审核误判严重:应该是在输入处直接使用简单的关键字进行过滤,几乎是白痴级别的判断水平,经常对正常的内容产生误判,并输出“提问包含违规内容,请修改后再次提问。”的错误提示。

- 垂直领域强化:针对代码解析、算法优化等场景深度优化,支持Python、Java等20+语言,输出可直接运行的高质量代码片段。

- 实时知识库调用:结合CSDN开发者社区亿级技术资源,实时检索GitHub、Stack Overflow等开源平台数据,确保答案的时效性与实用性。

超算互联网

官网链接:https://chat.scnet.cn/#/home

超算互联网仅提供蒸馏版模型(7B/14B/32B),不能联网,完全免费使用。

- 国家级资源支持:由国家超算中心牵头,依托强大的国家级超算资源,为模型运行提供有力的算力支撑,保障服务的稳定性。

- 特定模型支持:虽然提供的是蒸馏版模型,但能满足部分对模型性能要求不是极致的用户需求,在一些基础的文本处理、简单知识问答等场景下可发挥作用。

- 免费公益性质:完全免费的使用模式降低了用户使用门槛。

360 纳米AI助手

官网链接:https://bot.n.cn/

360 纳米 AI 搜索提供 “R1-360 专线” 和 “R1 满血版”,需消耗纳米币或活动限时免费体验次数。

- 多端适配:支持网页端与移动端(需下载APP),用户可通过“DeepSeek R1-360专线”选项调用模型。

- 多功能 AI 平台:整合了包括 豆包、Kimi 等在内的多种国内 AI 模型。

- 积分制使用:注册即赠100纳米积分,完成任务可获取更多额度,适合高频用户灵活调配资源。

- 专线优化:针对模型响应速度进行优化,尤其在移动端表现稳定,适合碎片化场景下的快速推理需求。

百度云千帆

官网链接:https://console.bce.baidu.com/qianfan/modelcenter

百度云千帆已正式上架DeepSeek-R1和V3模型,以API调用服务为主,并提供在线体验。其API服务一般是按Tokens计数等方式收费,也有免费体验活动。

- 价格:需要收费,提供免费体验额度,支持公有云部署,降低用户的使用门槛和成本。

- 云服务大模型平台:整合了各类大模型资源,并依托强大的云服务能力,提供模型部署、推理、训练等服务。

- DeepSeek-R1 限期免费:https://console.bce.baidu.com/qianfan/ais/console/onlineTest/LLM/DeepSeek-R1

字节跳动火山引擎

官网链接:https://console.volcengine.com/ark

字节跳动火山引擎支持V3、R1等不同尺寸的DeepSeek开源模型,可通过火山方舟调用。以API调用服务为主,并提供在线体验。其API服务一般是按Tokens计数等方式收费,也有免费体验活动。

- 价格:需要收费,每个模型提供50万Token免费体验额度,支持模型快速部署,方便用户快速搭建自己的应用。

- 云服务大模型平台:整合了各类大模型资源,并依托强大的云服务能力,提供模型部署、推理、训练等服务。

- DeepSeek-R1 限期免费:https://console.volcengine.com/ark/region:ark+cn-beijing/model/detail?Id=deepseek-r1

阿里云PAI

官网链接:https://pai.console.aliyun.com/

阿里云PAI Model Gallery支持一键部署DeepSeek-R1模型。以API调用服务为主。其API服务一般是按Tokens计数等方式收费,也有免费体验活动。

- 价格:需要收费,少数会提供在线体验。

- 云服务大模型平台:整合了各类大模型资源,并依托强大的云服务能力,提供模型部署、推理、训练等服务。

- DeepSeek-R1(API服务,未提供“在线体验”):https://pai.console.aliyun.com/?regionId=cn-shanghai&workspaceId=664274#/quick-start/models/DeepSeek-R1/intro

硅基流动

官网链接:https://cloud.siliconflow.cn/

硅基流动支持满血版DeepSeek R1模型,以API调用服务为主,并提供在线体验。其API服务一般是按Tokens计数等方式收费,也有少数限期免费模型。特色如下:

- 免费额度:新用户注册赠送2000万免费Tokens。(注:似乎有坑,官网说明为:平台 2000 万 Tokens 特指 Qwen2.5-14B-Instruct 模型单价下的数量,实际到账为 14 元平台配额)

- 多功能 AI 平台:整合了多种开源 AI 模型。

- DeepSeek-R1:https://cloud.siliconflow.cn/models?target=deepseek-ai/DeepSeek-R1,或 https://cloud.siliconflow.cn/models?target=Pro/deepseek-ai/DeepSeek-R1

- 联合服务:与华为云昇腾云服务联合推出推理服务,支持深度学习和长文本推理,在特定领域的推理能力表现出色。

其他

文思助手

官网链接:https://wensi.sodabot.cn/

功能丰富的 AI 写作服务平台,支持带DeepSeek-R1推理的AI对话,每日免费额度为1万字。

Fireworks

官网链接:https://fireworks.ai/models/fireworks/deepseek-r1

英文网站。以提供API服务为主。

英伟达

官网链接:https://build.nvidia.com/deepseek-ai/deepseek-r1

英文网站。提供API服务和在线体验。

POE

官网链接:https://poe.com/DeepSeek-R1

需要能访问外网。多功能 AI 平台,整合了包括DeepSeek、chatGPT、Claude在内的多种AI模型。